금주 캐치페이퍼는 ByteDance, NYU, Meta, Alibaba, CMU, Princeton 과 함께합니다. 3분만 투자해 쓱 둘러보고, 빠르게 바뀌는 기술의 방향성을 놓치지 마세요!

📈 최신 AI 트렌드 2줄 요약

🌟 최근 AI 연구에서는 자기 진화 에이전트와 월드 모델을 활용한 장기 시뮬레이션이 두드러지고 있으며, 물리 법칙을 고려한 로봇 제어와 3D 공간 인식 기술이 급속도로 발전하고 있습니다.

🚀 LLM의 추론 능력 향상을 위한 자기 개선 프레임워크와 강화학습 기법이 활발히 연구되고 있으며, 특히 이론적 기반을 갖춘 자기지도 학습과 세밀한 오류 수정 메커니즘이 주목받고 있습니다.

🌐 어떤 시점에서든 3D 공간을 완벽하게 재구성하다.

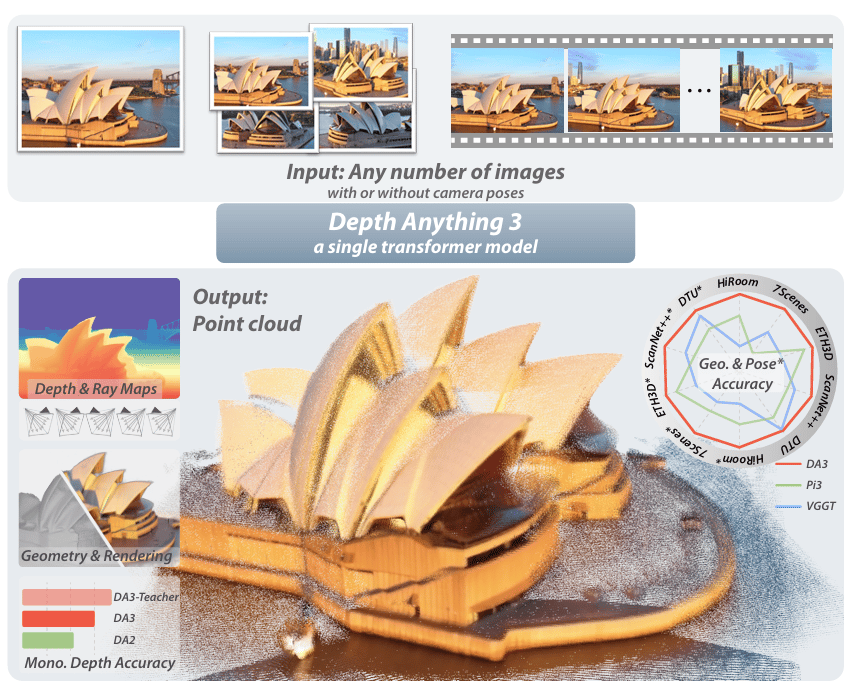

Depth Anything 3: Recovering the Visual Space from Any Views

🏛️ 소속: ByteDance

🏷️ 핵심 키워드: Depth-Ray Representation, Any-View Geometry, Unified Transformer

💭 이런 질문을 해본 적 있나요?

"단일 이미지만으로도 정확한 3D 공간을 복원할 수 있을까?"

"카메라 위치 정보 없이도 여러 시점을 통합할 수 있을까?"

"복잡한 구조 없이 하나의 모델로 모든 3D 작업을 처리할 수 있을까?"

모든 각도에서 동시에 세상을 바라보는 것처럼, Depth Anything 3는 단일 transformer로 임의 개수의 시점에서 일관된 3D 공간을 재구성합니다. 카메라 포즈 정보 유무와 관계없이 작동하며, depth-ray 표현만으로 복잡한 다중 작업 학습의 필요성을 제거했습니다. 특히 주목할 점:

기존 SOTA인 VGGT 대비 카메라 포즈 정확도 44.3%, 기하학적 정확도 25.1% 향상

Depth Anything 2를 능가하는 단안 깊이 추정 성능

단순한 vanilla transformer로 구조적 특수화 없이 달성한 최첨단 성능

🎯 왜 이것이 게임 체인저인가? : 전문화된 3D 아키텍처 → 통합된 plain transformer 기반 any-view 재구성의 전환점 강조

🔗 더 자세한 내용이 궁금하다면 : https://arxiv.org/abs/2511.10647

🧠 "휴리스틱 없는 자기지도 학습이 가능할까?"

LeJEPA: Provable and Scalable Self-Supervised Learning Without the Heuristics

🏛️ 소속: Brown University, New York University, Meta

🏷️ 핵심 키워드: Joint-Embedding Predictive Architecture, SIGReg, Isotropic Gaussian

💭 이런 질문을 해본 적 있나요?

"자기지도 학습에서 표현 붕괴를 이론적으로 방지할 수 있을까?"

"stop-gradient나 teacher-student 없이도 안정적인 학습이 가능할까?"

"단일 하이퍼파라미터만으로 다양한 아키텍처에 적용할 수 있을까?"

복잡한 트릭 없이 순수한 이론으로 완벽함을 추구하듯, LeJEPA는 등방성 가우시안 분포를 강제하여 표현 붕괴를 근본적으로 해결했습니다. Sketched Isotropic Gaussian Regularization(SIGReg)을 도입하여 stop-gradient, teacher-student, 하이퍼파라미터 스케줄러 등 모든 휴리스틱을 제거했습니다. 특히 주목할 점:

ImageNet-1k에서 ViT-H/14로 79% 정확도 달성

단 하나의 trade-off 하이퍼파라미터로 ResNets, ViTs, ConvNets 모두 지원

학습 손실과 다운스트림 성능 간 99% 상관관계로 라벨 없는 모델 선택 가능

🎯 왜 이것이 게임 체인저인가? : 휴리스틱 의존 자기지도 학습 → 이론적으로 증명 가능한 원칙 기반 학습의 전환점 강조

🔗 더 자세한 내용이 궁금하다면 : https://arxiv.org/abs/2511.08544

🤖 스스로 학습 목표를 설정하는 AI 에이전트의 탄생

AgentEvolver: Towards Efficient Self-Evolving Agent System

🏛️ 소속: Alibaba Group, Tongyi Lab

🏷️ 핵심 키워드: Self-Evolving Agent, Curiosity-Driven, Fine-Grained Credit Assignment

💭 이런 질문을 해본 적 있나요?

"AI 에이전트가 스스로 학습 목표를 생성할 수 있을까?"

"수작업 데이터셋 없이도 효율적인 탐색이 가능할까?"

"에이전트가 각 행동의 기여도를 세밀하게 평가할 수 있을까?"

스스로 성장하는 생명체처럼, AgentEvolver는 호기심 주도 작업 생성과 경험 재사용을 통해 자율적으로 진화합니다. Self-questioning으로 작업을 생성하고, Self-navigating으로 탐색 효율을 높이며, Self-attributing으로 단계별 보상을 할당합니다. 특히 주목할 점:

7B 모델로 평균 29.4% 포인트 성능 향상

훈련 단계를 최대 67%까지 단축하여 수렴 속도 개선

수작업 데이터셋 의존도 대폭 감소

🎯 왜 이것이 게임 체인저인가? : 수동적 데이터 의존 에이전트 → 자율적 진화 에이전트 시스템의 전환점 강조

🔗 더 자세한 내용이 궁금하다면 : https://arxiv.org/abs/2511.10395

🔧 인간처럼, 많은 기하학적 정보를 한번에 통합하는 지능의 출현

OmniVGGT: Omni-Modality Driven Visual Geometry Grounded

🏛️ 소속: Alibaba Group, Sun Yat-Sen University, NUS, NTU, HKUST

🏷️ 핵심 키워드: Geometric Modalities, GeoAdapter, Stochastic Multimodal Fusion

💭 이런 질문을 해본 적 있나요?

"깊이 맵, 카메라 내부 파라미터, 포즈 정보를 동시에 활용할 수 있을까?"

"추가 입력 없이도 RGB만으로 SOTA 성능을 낼 수 있을까?"

"추론 속도 저하 없이 여러 기하학적 정보를 통합할 수 있을까?"

여러 감각을 동시에 활용하는 것처럼, OmniVGGT는 임의 개수의 보조 기하학적 모달리티를 seamlessly 통합합니다. zero-initialized convolution을 사용하는 GeoAdapter로 안정적 최적화를 보장하고, 확률적 다중모달 융합으로 과적합을 방지합니다. 특히 주목할 점:

보조 입력 활용 시 기존 방법 대비 우수한 성능

RGB만 사용해도 state-of-the-art 결과 달성

로봇 조작 작업에서 vanilla 포인트클라우드 기반 대비 일관된 성능 향상

🎯 왜 이것이 게임 체인저인가? : RGB 전용 모델 → 유연한 다중모달 3D foundation 모델의 전환점 강조

🔗 더 자세한 내용이 궁금하다면 : https://arxiv.org/abs/2511.10560

📊 "강화학습이 실제로 어떻게 작동하는지 파라미터 수준에서 이해하다"

The Path Not Taken: RLVR Provably Learns Off the Principals

🏛️ 소속: Meta, The University of Texas at Austin

🏷️ 핵심 키워드: RLVR, Three-Gate Theory, Off-Principal Learning

💭 이런 질문을 해본 적 있나요?

"강화학습이 왜 소수의 파라미터만 수정하는 것처럼 보일까?"

"RL과 SFT가 파라미터 공간에서 어떻게 다르게 작동할까?"

"RLVR의 성능 향상을 기하학적으로 설명할 수 있을까?"

숨겨진 경로를 따라가듯, RLVR은 주요 방향(principal directions)을 피하고 낮은 곡률의 off-principal 부분공간에서 업데이트를 수행합니다. Three-Gate Theory를 통해 KL 제약, 모델 기하학, 정밀도가 어떻게 상호작용하는지 밝혔습니다. 특히 주목할 점:

RLVR은 36-92%의 업데이트 희소성을 보이는 반면 SFT는 0.6-18.8%

스펙트럼 구조를 보존하며 최소 드리프트로 성능 향상

SFT 시대의 PEFT 방법을 RL에 직접 적용하는 것의 한계 입증

🎯 왜 이것이 게임 체인저인가? : 블랙박스 RL 이해 → 파라미터 수준 화이트박스 분석의 전환점 강조

🔗 더 자세한 내용이 궁금하다면 : https://arxiv.org/abs/2511.08567

🤖 상상 속에서 로봇을 훈련시키다

WMPO: World Model-based Policy Optimization for Vision-Language-Action Models

🏛️ 소속: ByteDance, HKUST

🏷️ 핵심 키워드: World Model, On-Policy RL, VLA Policy Optimization

💭 이런 질문을 해본 적 있나요?

"실제 환경과 상호작용 없이 로봇 정책을 학습할 수 있을까?"

"월드 모델에서의 상상만으로 자기 교정 능력을 습득할 수 있을까?"

"샘플 효율성과 성능을 동시에 개선할 수 있을까?"

WMPO는 픽셀 기반 월드 모델에서 on-policy 강화학습을 수행하여 실제 로봇 상호작용 없이 정책을 최적화합니다. policy behavior alignment로 상태 분포 불일치를 해결하고, 완전한 시행 생성으로 신뢰할 수 있는 보상 할당을 구현했습니다. 특히 주목할 점:

샘플 효율성을 크게 개선하며 실제 궤적 기반 방법 능가

자기 교정과 같은 창발적 행동 발현

공간적, 배경, 텍스처 변화에 대한 강력한 일반화

🎯 왜 이것이 게임 체인저인가? : 실제 환경 의존 RL → 월드 모델 기반 순수 상상 학습의 전환점 강조

🔗 더 자세한 내용이 궁금하다면 : https://arxiv.org/abs/2511.09515

💡 소크라테스식 질문으로 LLM 추론을 개선하다

SSR: Socratic Self-Refine for Large Language Model Reasoning

🏛️ 소속: The University of Texas at Austin, Rutgers University, Salesforce AI Research

🏷️ 핵심 키워드: Socratic Steps, Step-Level Verification, Self-Consistency

💭 이런 질문을 해본 적 있나요?

"LLM의 추론 과정을 세밀하게 검증할 수 있을까?"

"불확실한 단계만 선택적으로 개선할 수 있을까?"

"전체적 판단이 아닌 단계별 오류 교정이 가능할까?"

소크라테스의 문답법처럼, SSR은 추론을 검증 가능한 (하위 질문, 하위 답변) 쌍으로 분해하여 세밀한 신뢰도 추정을 가능하게 합니다. self-consistency 체크를 통해 불확실한 단계를 정확히 찾아내고 선택적으로 개선합니다. 특히 주목할 점:

5개 추론 벤치마크에서 기존 self-refinement 방법 일관되게 능가

더 신뢰할 수 있는 개선 궤적 제공

수학적 및 논리적 추론 작업 모두에서 정확도 및 해석 가능성 향상

🎯 왜 이것이 게임 체인저인가? : 전체적 자기 개선 → 세밀한 단계별 검증 및 수정의 전환점 강조

🔗 더 자세한 내용이 궁금하다면 : https://arxiv.org/abs/2511.10621

🦾 인간 동작을 로봇의 물리적 궤적으로 변환하다

SPIDER: Scalable Physics-Informed Dexterous Retargeting

🏛️ 소속: Carnegie Mellon University, Meta, FAIR at Meta

🏷️ 핵심 키워드: Physics-Based Retargeting, Virtual Contact Guidance, Dexterous Manipulation

💭 이런 질문을 해본 적 있나요?

"인간의 동작을 로봇에 직접 적용할 수 있을까?"

"물리적 실행 가능성을 보장하면서 대규모 데이터를 생성할 수 있을까?"

"단일 RGB 카메라만으로도 정확한 retargeting이 가능할까?"

통역사가 언어를 번역하듯, SPIDER는 인간 시연을 로봇의 동적으로 실행 가능한 궤적으로 변환합니다. curriculum 스타일의 가상 접촉 안내로 올바른 접촉 시퀀스를 보장하고, 대규모 물리 기반 샘플링으로 확장성을 달성했습니다. 특히 주목할 점:

9개의 다양한 휴머노이드/손재주 embodiment와 6개 데이터셋에 걸쳐 확장

표준 샘플링 대비 18% 성공률 향상, RL 기반 방법보다 10배 빠름

2.4M 프레임의 동적 실행 가능 로봇 데이터셋 생성

🎯 왜 이것이 게임 체인저인가? : 키네마틱 전용 retargeting → 물리 기반 동적 실행 가능 변환의 전환점 강조

🔗 더 자세한 내용이 궁금하다면 : https://arxiv.org/abs/2511.09484

🎨 텍스트와 이미지가 궤적 전체에서 상호작용하다

MMaDA-Parallel: Multimodal Large Diffusion Language Models for Thinking-Aware Editing and Generation

🏛️ 소속: Peking University, ByteDance, Princeton University, CASIA, The University of Chicago

🏷️ 핵심 키워드: Parallel Diffusion, Cross-Modal Alignment, Trajectory-Level RL

💭 이런 질문을 해본 적 있나요?

"텍스트 추론과 이미지 생성을 동시에 수행할 수 있을까?"

"순차적 오류 전파를 어떻게 방지할 수 있을까?"

"생성 궤적 전체에서 모달 간 일관성을 유지할 수 있을까?"

오케스트라의 악기들이 조화를 이루듯, MMaDA-Parallel은 denoising 궤적 전체에서 텍스트와 이미지 간 연속적 양방향 상호작용을 가능하게 합니다. Parallel Reinforcement Learning(ParaRL)을 도입하여 궤적을 따라 의미적 보상을 적용해 교차 모달 일관성을 강화했습니다. 특히 주목할 점:

ParaBench에서 SOTA 모델 Bagel 대비 Output Alignment 6.9% 향상

오류 전파를 효과적으로 완화하는 병렬 프레임워크

최종 결과뿐만 아니라 중간 단계에서도 일관성 유지

🎯 왜 이것이 게임 체인저인가? : 순차적 autoregressive 생성 → 병렬 교차 모달 diffusion의 전환점 강조

🔗 더 자세한 내용이 궁금하다면 : https://arxiv.org/abs/2511.09611

매일 화요일 오전 8시,

바쁜 당신을 기술 발전에 뒤쳐지지 않게 만들어줄

최신 AI 트렌드가 요약 정리본으로 전달됩니다!